La reconnaissance automatique fait gagner un temps considérable par rapport à la saisie manuelle. Il faut environ 8 heures d’un travail très fatigant pour traiter « à la main » un média d’une heure, comme l’enregistrement d’une conférence.

Les progrès de l’IA ont été fulgurants dans la qualité de la retranscription. Jusqu’en 2022, la fiabilité du résultat était de l’ordre de 75%, ce qui obligeait à des relectures et corrections manuelles. Le temps de traitement était relativement long et il fallait indiquer la langue à reconnaître.

Avec la dernière version mise en production en décembre 2023, le taux moyen d’erreur a été ramené à 1% ! Le gain de temps de traitement est tout aussi spectaculaire, avec seulement une minute pour traiter un fichier audio ou vidéo d’une heure. Il n’est désormais plus nécessaire d’indiquer la langue source car elle est reconnue automatiquement. Mieux : si plusieurs langues sont parlées dans une vidéo, elles seront toutes reconnues, sans configuration préalable. Le gain en simplicité et en productivité est considérable.

La génération automatique de sous-titres et de transcriptions fait partie des services optionnels de Streamlike.

Différence entre transcription et sous-titres

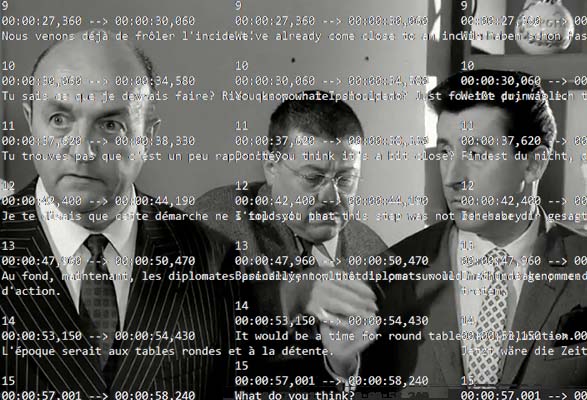

Une retranscription par reconnaissance automatique permet de produire une transcription (un texte) et des sous-titres (un texte structuré avec des indications temporelles).

La transcription est une métadonnée d’un média qui répond à un besoin d’accessibilité, pour retranscrire la piste audio du média à une personne malentendante, et de recherche textuelle ou de SEO. La transcription est un texte. On peut la lire sans jouer le média (audio ou vidéo).

Les sous-titres n’apparaissent qu’à la lecture du média, auxquels ils sont synchronisés. On peut les activer pour les faire apparaître en superposition du lecteur, choisir une langue parmi celles qui sont disponibles, ou les désactiver.

Traductions automatiques

Jusqu’à présent, le plus rapide était de faire traduire un fichier de sous-titre par une IA. Les formatages et timecodes étant généralement ignorés, le fichier traduit est directement exploitable, moyennant une relecture et quelques corrections. Le problème est qu’il s’agit de traductions ligne à ligne et que le sens de phrases longues peut être perdu. De plus, un découpage unique ne conviendra pas à toutes les langues, le nombre de mots peut varier considérablement d’une langue à l’autre.

Désormais, l’IA peut se charger de générer directement des sous-titres dans n’importe quelle langue cible. Le sens du texte est préservé et le découpage s’adapte au débit de mots de la langue.

Des précautions indispensables

Il reste recommandé de vérifier les retranscriptions. Le bruit ambiant, les propos peu intelligibles, avec accents ou qui se chevauchent peuvent toujours produire des erreurs. Si les marques sont généralement bien reconnues, l’orthographe de certains noms propres ou d’acronymes exotiques reste à surveiller.

Soumettre des données à une IA n’est jamais anodin. Dans le cas de contenus d’entreprises, certains propos peuvent être de nature confidentielle. Aussi, l’IA utilisée par Streamlike est hébergée en France. Aucune donnée n’est conservée une fois que le traitement a été réalisé. Les données soumises ou produites ne circulent jamais hors de France et ne sont pas utilisées pour l’entraînement des modèles d’IA.

Exemple de retranscription automatique

Nous avons pris pour exemple un atelier sur le « Streaming Responsable ». La vidéo dure 28 minutes et sa retranscription a été effectuée en moins d’une minute. La relecture et quelques rares corrections faites au moyen de l’éditeur de sous-titres intégré à Streamlike ont pris moins de 5 minutes.

[English] : AI-based subtitles and translations